Pourquoi intégrer ChatGPT directement dans WordPress

Les plugins WordPress qui intègrent ChatGPT sont légion — mais ils ont tous le même défaut : ils sont génériques, souvent lourds, et ne s’adaptent pas aux besoins éditoriaux spécifiques d’un projet. Développer sa propre intégration permet de contrôler précisément ce que l’IA peut faire, comment elle interagit avec l’interface d’édition, quels prompts système sont utilisés, et comment les suggestions sont présentées à l’éditeur. Sur plusieurs projets clients, j’ai mis en place des interfaces de génération assistée par IA qui ont transformé le workflow éditorial des équipes — voici la méthode complète.

Configuration de l’API OpenAI dans WordPress

La première étape est de créer une page de réglages dans l’administration WordPress pour stocker la clé API OpenAI de manière sécurisée. La clé est saisie dans un champ de type password, stockée via update_option() après sanitisation, et jamais affichée en clair après enregistrement.

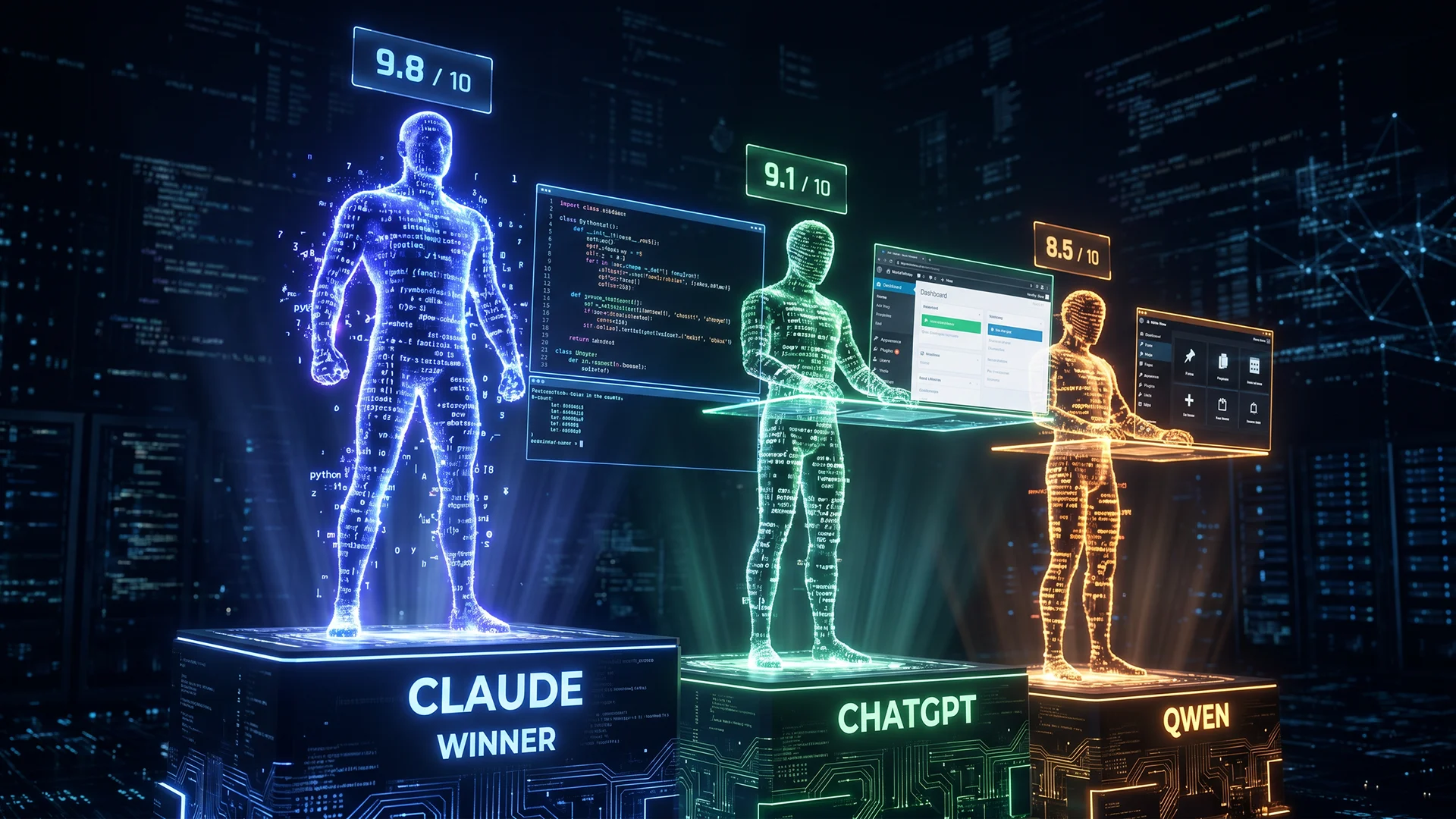

Le modèle recommandé en 2025 pour les cas d’usage de génération de contenu est gpt-4o-mini — excellent rapport qualité/coût pour la rédaction. Pour des tâches plus complexes nécessitant un raisonnement approfondi, gpt-4o reste la référence. Les paramètres clés à configurer : model, max_tokens (limiter la longueur des réponses), temperature (0.7 pour un équilibre créativité/cohérence), et system (le prompt système qui définit le rôle et le ton de l’IA).

L’interface back-office : un bouton d’assistance à la rédaction

L’implémentation la plus efficace est d’ajouter un bouton discret dans l’interface d’édition WordPress qui ouvre une modale d’assistance IA. L’éditeur saisit une instruction en langage naturel (« Rédige une introduction percutante pour cet article sur le SEO technique »), clique sur le bouton, et reçoit une suggestion qu’il peut accepter, modifier ou rejeter. Le flux technique repose sur une requête AJAX WordPress vers le serveur, qui appelle l’API OpenAI et retourne la réponse.

add_action( 'wp_ajax_johnweb_generate_content', 'johnweb_handle_ai_generation' );

function johnweb_handle_ai_generation() {

check_ajax_referer( 'johnweb_ai_nonce', 'nonce' );

if ( ! current_user_can( 'edit_posts' ) ) wp_die();

$instruction = sanitize_textarea_field( $_POST['instruction'] ?? '' );

$contexte = sanitize_textarea_field( $_POST['contexte'] ?? '' );

// Appel API OpenAI...

}

Le prompt système : la clé de la qualité éditoriale

La qualité des contenus générés dépend directement de la qualité du prompt système configuré. Ce prompt définit l’identité, le ton et les contraintes de l’IA. Sur un projet blog technique WordPress, le prompt système pourrait être : « Tu es un rédacteur Web expert en développement WordPress et SEO technique. Tu rédiges en français, avec un ton professionnel mais accessible, sans jargon inutile. Tu utilises des exemples concrets et pratiques. Tu n’utilises jamais de superlatifs ni de formules marketing. Chaque contenu que tu génères doit apporter une valeur informative réelle. » Un prompt système bien conçu réduit drastiquement la quantité de corrections nécessaires sur les contenus générés.

Les bonnes pratiques éditoriales avec l’IA

L’IA génère du contenu qui sonne bien mais qui peut manquer de substance réelle. Les pièges les plus fréquents : le contenu générique qui dit tout sans rien apprendre, les affirmations inexactes présentées avec confiance, la structure prévisible (introduction – trois points – conclusion) qui produit des articles interchangeables. La règle que j’applique sur tous mes projets est simple : l’IA génère des brouillons et des suggestions, mais chaque paragraphe publié doit avoir été lu, compris et validé par un humain qui assume la responsabilité éditoriale du contenu. L’IA accélère la rédaction — elle ne remplace pas le jugement éditorial.

Limiter les coûts et monitorer l’usage

L’API OpenAI facture au token — chaque requête a un coût. Sur un site avec plusieurs éditeurs qui utilisent l’assistance IA intensivement, les coûts peuvent s’accumuler rapidement. Implémenter un système de rate limiting par utilisateur (nombre maximum de requêtes par jour), logger chaque appel API avec le nombre de tokens consommés, et configurer des alertes de budget dans le dashboard OpenAI sont des précautions indispensables avant tout déploiement multi-utilisateurs.